Les victimes de fraudes en ligne se multiplient. L’expansion de l’intelligence artificielle offre de nouvelles perspectives aux escrocs : les formes que prennent ces escroqueries se diversifient et il devient davantage difficile de les cerner.

L’escroquerie en ligne : un fait historique

L’escroquerie est un délit qui consiste « pour l’escroc à tromper une personne (physique ou morale) pour la pousser à lui remettre un bien, de l’argent ou à fournir un service. La victime doit avoir agi volontairement après avoir été trompée » (selon le site officiel de l’administration française). A partir des années 1990, les escrocs s’emparent du cyberespace afin d’y mener leurs actions illégales : l’escroquerie en ligne voit le jour.

Elles peuvent prendre plusieurs formes. Elles peuvent être simples ou bien solliciter d’une mise en scène avec l’action d’un tiers. La plus répandue d’entre elles restent le phishing (ou « hameçonnage »). Une personne malveillante se fait passer pour un site familier, un organisme officiel, ou encore un contact piraté afin de soutirer les données personnelles ou encore les coordonnées bancaires de la victime et en faire un usage frauduleux. Divers exemples sont connus : de la fausse vente en ligne au faux conseiller bancaire en passant par le SMS frauduleux donnant un lien vers un faux site. Une des conséquences possibles est le vol d’identité : les escrocs utilisent les données à des fins qui nuisent généralement à l’utilisateur.

L’arrivée d’un nouvel outil : l’Intelligence Artificielle

L’expansion rapide de l’intelligence artificielle va permettre d’offrir de nouvelles perspectives aux escrocs. L’escroquerie en ligne devient davantage sophistiquée. Ceux qu’on appelle les « brouteurs » utilisent les chatbots, notamment dans le cadre du phishing, afin d’améliorer leurs textes envoyés par SMS. Ces derniers paraissent plus vrais et il devient de plus en plus compliqué de les différencier. Cela va leur permettre de gagner en efficacité.

Les arnaqueurs en ligne mobilisent également des enregistrements audio ou vidéo réalisés ou modifiés par l’intelligence artificielle, aussi appelés deepfake. La reproduction de voix, d’images et même de vidéos permet de personnaliser les escroqueries au cas par cas après une collecte des informations en amont des opérations.

Des victimes de plus en plus nombreuses

Les victimes se font de plus en plus nombreuses. Selon le ministère de l’Intérieur, entre 2016 et 2023, une hausse de 8% par an du nombre d’escroqueries en ligne est à noter, avec plus de 130 000 infractions en 2023.

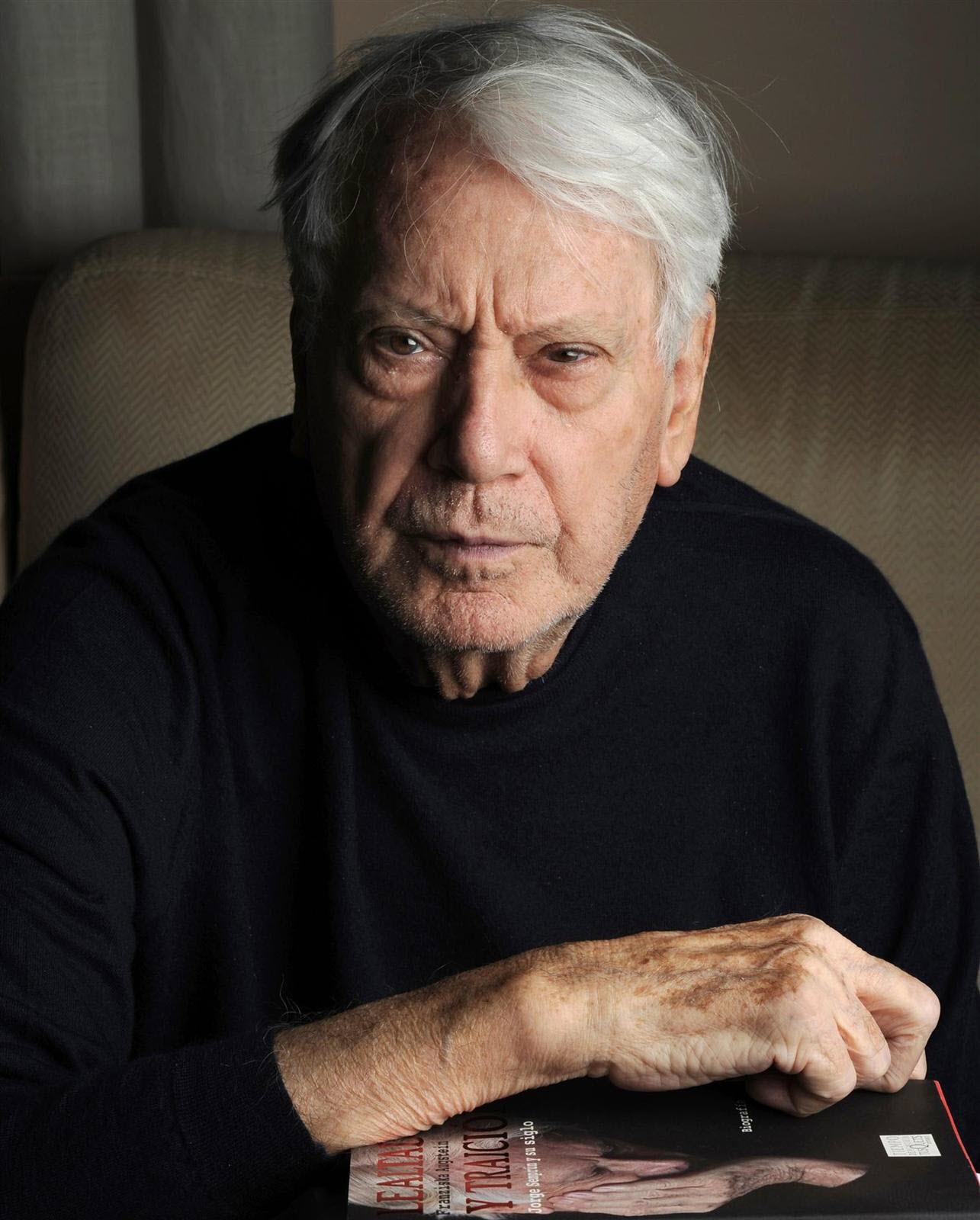

L’une d’entre elles, Anne, est une femme de 53 ans victime d’un « faux Brad Pitt ». En ce début d’année, elle a fait le tour des réseaux sociaux, souvent moquée et jugée crédule. Elle a perdu près de 830 000 euros en souhaitant aider celui avec qui elle pensait filer le grand amour. Ils commencent à discuter sur Instagram, réseau social qu’elle vient alors tout juste d’installer et avec lequel elle se familiarise à peine. Il lui dit être atteint d’un cancer du rein et ne pas pouvoir régler ses frais de santé en raison du divorce avec Angélina Jolie. Pendant près d’un an et demi, elle est, en réalité, en proie à des escrocs. Ils utilisent des vidéos, des appels, une mise en scène avec un faux manager, un faux médecin, une fausse mère, une fausse fille et même un faux agent du FBI.

Anne n’est pas seule. En février, sur le même modèle, un homme résidant à Shanghai se voit perdre près de 26 000 euros, somme qu’il verse à sa « petite-amie » fictive, qui est, sans qu’il le sache, générée par l’IA. Les mêmes méthodes sont utilisées. Il ne la rencontre jamais et pense pouvoir l’aider financièrement en lui faisant des virements sur « son » compte bancaire.

A plus grande échelle, un employé dans le département financier d’une entreprise chinoise à Hong Kong s’est vu effectuer quinze transactions, pour un montant total de 26 millions de dollars américains. Il pensait être en contact avec sa hiérarchie avec qui il participe à une visioconférence, à laquelle il voit se connecter plusieurs de « ses collègues ». Il est pourtant le seul humain en ligne, les autres ont tous été générés par l’intelligence artificielle.

Parallèlement, Daisy, un modèle d’IA qui reprend la voix d’une personne féminine âgée, a été développée par Virgin Media O2, un opérateur téléphonique britannique : elle discute pendant des heures, faisant perdre du temps aux arnaqueurs. Elle montre que si l’IA a été détournée à des fins frauduleuses, elle peut aussi être un moyen de défense.

Laisser un commentaire